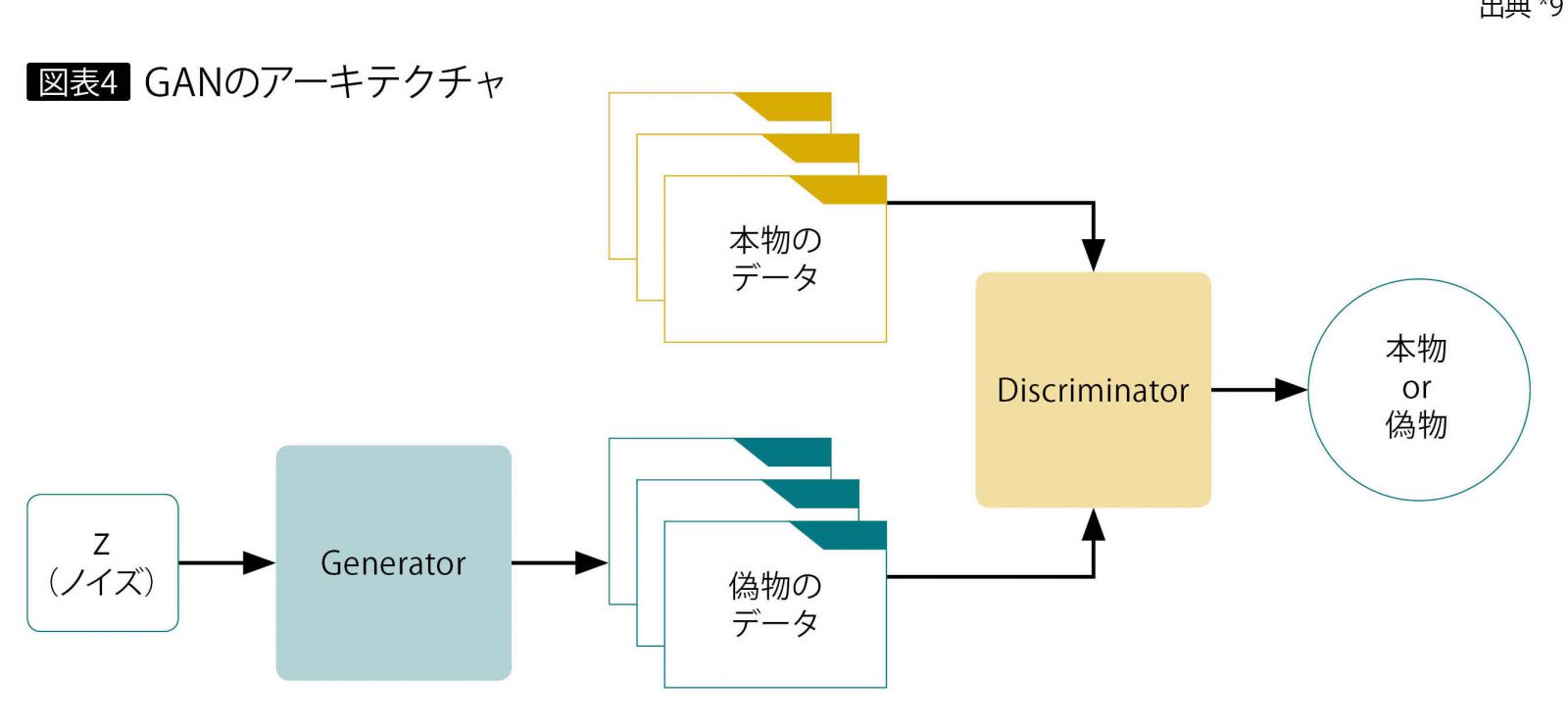

GAN

一回触ってみたい

https://www.imagazine.co.jp/gan%EF%BC%9A敵対的生成ネットワークとは何か%E3%80%80%EF%BD%9E%E3%80%8C教師/

- z(ノイズ)がシード値みたいなもの

- シード値を動かすとだんだん画像が変わっていくのね

- よくGANで生成された画像で見るやつか

- 対象読者ど真ん中な感じ

- Discriminator

- まあこれは普通(?)の分類問題のニューラルネットワークって感じ

- Generator

- 学習

- 「真データを使って、Discriminatorのみを学習」

- 「Discriminatorを使って、Generatorを訓練」

- の二つを交互?にやる感じかな

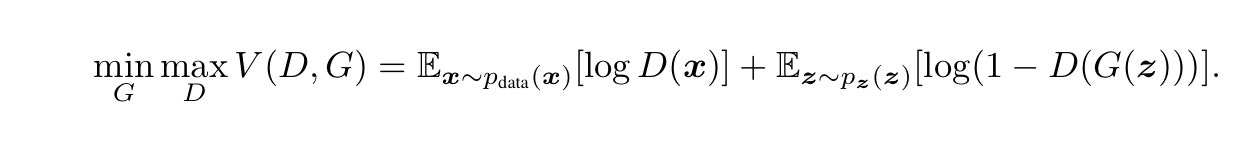

- Loss Function

- $\mathbb{E}$の意味がわからないな

- Discriminatorの学習では、V(D, G)を最大化させたい

- $\log D(x)$を最大化したい = 真データ(x)の時に1を出力させたい

- $\log (1-D(G(z)))$を最大化したい = 偽データ(G(z))の時に0を出力させたい

- Generatorの学習の時は、V(D,G)を最小化させたい

- $\log (1-D(G(z)))$を最小化したい = 偽データ(G(z))の時に1を出力させたい

- つまり、Discriminatorと真逆の方向に学習